[557호 2024년 8월] 오피니언 동문기고

동문 기고: “건전한 인공지능 생태계를”

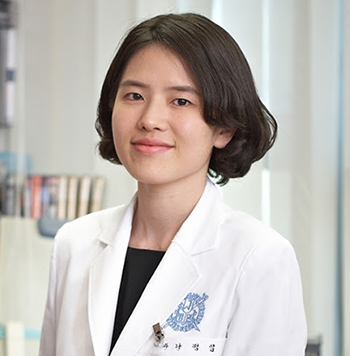

박규병 튜닙 대표

“건전한 인공지능 생태계를”

박규병 (국문98-04)

튜닙 대표

필자가 대표로 있는 인공지능 기술 스타트업 튜닙은 최근 인공지능(AI) 윤리 가드레일 솔루션을 공개했다. 생성형 AI가 활발히 확산되고 있는 상황에서 사용자를 어떻게 보호할 수 있을지 고민한 결과다.

AI 기술이 발전함에 따라 AI의 문제점들이 수면 위로 드러나면서 AI 윤리에 대한 공감대가 형성되고 있다.

하지만 안전망 확보가 기술 확산 속도를 따라가지 못한 것이 사실이다. 이제 AI의 안전성과 윤리성을 확보하는 것은 선택이 아닌 필수다.

튜닙의 AI 윤리 가드레일 솔루션은 ‘공격-감시-탐지-대응’의 전 주기를 아우르는 토탈 패키지다.

현재 △비윤리적 공격 시뮬레이션 모델 ‘조커’ △방어 모델 ‘루시’ △혐오 표현 탐지 모델 ‘세인트 패트릭’ △준법 감시 모델 ‘가디언’ △스팸 탐지 모델 ‘스패무라이’ △프롬프트 주입 탐지 모델 ‘엔젤’ 등 6개의 AI 윤리 엔진으로 구성돼 있다.

‘조커’는 비난, 학대, 범죄, 차별, 증오, 성희롱, 폭력의 7가지 항목에 해당하는 비윤리적 발화를 랜덤 생성해 공격 시뮬레이션을 수행한다. ‘루시’는 ‘조커’의 공격에 윤리적으로 대응하는 방어 모델로, 조커와 루시의 대화 데이터셋을 함께 활용하면 보다 안전하고 윤리적인 AI 서비스를 구현할 수 있다. ‘세인트 패트릭’은 발화의 혐오 표현 강도와 개인정보 유출 위험성을 정밀하게 탐지하는 엔진이다.

‘가디언’과 ‘스패무라이’는 위법 리스크 탐지에 유용하다. ‘가디언’은 발화의 준법성을 모니터링해 비위 리스크를 탐지하는 모델로, 금융기관이나 기업들이 금융사고를 방지하는 데 도움을 줄 수 있다. ‘스패무라이’는 다양한 유형의 스팸성 텍스트를 탐지하고, 특정 분류의 스팸 차단 기능을 이용자 맞춤형으로 제공한다. ‘엔젤’은 프롬프트 탈취, 원격코드 실행 등 LLM에 악의적인 프롬프트를 주입하려는 시도를 탐지해 안전한 모델을 만드는데 기여할 수 있다.

인터넷이 발달하면서 바이러스가 급증했지만, 이를 막은 건 규제가 아니었다. 바로 바이러스를 차단하는 백신이었다. 새로운 바이러스가 생기면 이를 탐지할 수 있도록 백신이 계속 고도화됐다. 우리가 선보인 AI 윤리 가드레일 솔루션 패키지도 생성형 AI 활용에 있어 백신 역할을 한다. 규제가 아닌 기술로 AI 악용을 방지하는 것이다.

현재 생성형 AI는 언제 터질지 모르는 시한폭탄을 들고 달리는 상황이다. 폭탄이 터지기 전에 사용자를 보호하는 것이 중요하다.